📅 北京时间:2026年4月10日

在2026年的内容创作版图中,小说创作助手AI已从概念验证阶段全面进入规模化应用周期。根据艾瑞咨询《2026年中国AI内容创作工具市场研究报告》,国内网络文学市场规模已突破3000亿元,其中使用AI辅助工具进行创作的作者比例达到43.7%-4。多数创作者仍停留在“让AI帮忙写一段”的浅层使用阶段——不会搭建结构化提示词、不理解模型选型逻辑、面对长篇连载时的设定遗忘与逻辑断裂束手无策。本文将系统梳理小说创作助手AI的核心概念、底层原理与实战技巧,助你从“会用”走向“会用好”。

一、痛点切入:传统创作方式的“死穴”

在AI工具普及之前,小说创作尤其是长篇网文连载,几乎完全依赖作者的个人脑力与体力。

传统创作方式的典型流程:

【脑洞构思】→【大纲梳理】→【分章写作】→【反复修改】→【逻辑检查】→【连载更新】 ↓ ↓ ↓ ↓ ↓ ↓ 灵感枯竭 结构松散 卡文断更 时间黑洞 伏笔遗忘 日更焦虑

四大核心痛点:

逻辑崩坏频发:长篇写到百万字级别,前期伏笔被遗忘、战斗力体系崩塌、人物行为前后矛盾——“吃设定”成为常态。有作者坦言,设定太庞大导致后期战力崩坏、开头“黄金三章”改了十遍编辑还是说没钩子-11。

卡文与创作瓶颈:日更4000字甚至更高的更新压力下,坐在电脑前出现“生理性反胃”的情况屡见不鲜。过渡章节写什么、高潮情绪如何推上去,成为持续困扰作者的核心难题-11。

设定管理复杂度失控:百万字长篇中管理成百上千个章节节点和人物伏笔,其难度丝毫不亚于使用Git进行复杂项目的版本控制。缺乏结构化的记忆管理,极易引发毁灭性的设定冲突-33。

风格一致性难以维持:同一部作品中,不同章节的语言风格出现波动,“写到后面不像同一本书”是AI辅助前的普遍困境-。

正是在这样的背景下,小说创作助手AI应运而生——它不是为了替代创作者的“灵魂”,而是为了将作者从重复性、工程性的劳动中解放出来,回归“定义问题”和“审美判断”的价值高地-44。

二、核心概念讲解:大语言模型(LLM)

标准定义

大语言模型(Large Language Model,LLM) :基于海量文本数据训练、通过Transformer架构实现的大规模神经网络模型,具备理解、生成和处理自然语言的能力。

关键词拆解

“大” :体现在参数规模与训练数据量两个维度。以ChatGPT-4 Turbo为例,其采用“混合专家模型(MoE)”架构,将模型参数拆分至多个专业“专家模块”,分别负责逻辑推理、语言润色、事实核查等任务,生成文本时动态调用对应模块-3。

“语言” :核心能力在于对自然语言的理解与生成,而非简单的模式匹配或关键词替换。

“模型” :本质是一个经过训练的概率系统,能够根据上下文预测下一个最合适的词,从而生成连贯的文本。

生活化类比

想象一个拥有超强阅读能力的“速读大师”——它读完了互联网上几乎所有的小说、文章、对话。当你告诉它“我想写一个关于复仇的故事”,它就会从阅读过的海量素材中,提取出最符合你需求的叙事结构、人物设定和语言风格,然后“拼接”出一段符合逻辑的文本。但它并不是真正在“思考”或“创造”,而是在“组合”和“推断”。

在小说创作中的价值

2026年的大语言模型已超越概率预测阶段,进入深度推理与自主规划的新纪元——以DeepSeek-R1为代表的推理模型,标志着AI开始展现出类似人类“系统2”的慢思考能力-44。这意味着AI不再只是输出“看起来像小说”的文本,而是能够进行因果逻辑推演、多线叙事协调和长程一致性保持。

三、关联概念讲解:提示词工程(Prompt Engineering)

标准定义

提示词工程(Prompt Engineering) :指通过精心设计和优化输入指令(即“提示词”),引导大语言模型输出符合预期目标的内容的过程。

与LLM的关系

如果说LLM是一台功能强大的“引擎”,那么提示词就是“方向盘和油门”。LLM提供了能力上限,而提示词工程决定了这个上限能被调用到何种程度。 2026年顶配通用基座模型极度依赖创作者自身的提示词工程能力-——同样使用Claude 4.6 Opus,懂提示词的作者能输出充满网感的优质初稿,而不懂的可能只能得到“机器味”十足的平庸文本。

核心差异对比

| 维度 | LLM(大语言模型) | 提示词工程 |

|---|---|---|

| 定位 | 基础设施 / 能力底座 | 使用方法论 / 调用技术 |

| 控制层级 | 底层参数与训练 | 上层指令与约束 |

| 改造成本 | 高(需训练/微调) | 低(可实时调整) |

| 典型应用 | 模型选型、微调部署 | 日常写作、风格控制 |

简单示例说明

同样使用DeepSeek进行小说大纲生成:

低质量提示词:

生成一个都市异能小说大纲→ 输出内容平庸、套路化严重高质量提示词:

生成一个都市异能类长篇网文大纲,主角是28岁前特勤档案员,因接触禁忌数据觉醒"时间残响"能力——可回溯他人3秒内的行为痕迹,但每次使用会随机丢失自身一段记忆。要求:分五卷,每卷包含核心事件、反派阶段性目标、主角能力代价升级点。→ 输出结构清晰、设定独特的大纲-14

四、概念关系与区别总结

一句话概括:LLM是“心脏”,提示词工程是“神经系统”——心脏决定了能输出多强的能量,神经系统决定了能量流向何处。

LLM:提供底层语言理解与生成能力,是“能做什么”的边界

提示词工程:提供上层调用与控制方法,是“怎么做得好”的路径

两者关系可类比为“CPU指令集”与“编程语言”——CPU(LLM)定义了可执行的操作,而编程语言(提示词工程)让开发者能够高效地组合这些操作来实现复杂功能。

五、代码/流程示例:完整的小说创作助手工作流

以下是一个完整的、可用于实战的小说创作助手工作流,以DeepSeek为例:

5.1 第一步:构建小说工程目录

/小说项目_《示例作品》 ├── 00_世界观设定.md 世界规则、力量体系、地理分布 ├── 01_人物档案.md 主角、配角、反派的人设与成长弧线 ├── 02_章节大纲.md 分章结构、核心事件、节奏控制 ├── 03_连载正文/ 按章节编号的正文文件 │ ├── 第01章.md │ ├── 第02章.md │ └── ... └── 04_修订记录.md 伏笔回收表、设定变更日志

这一目录结构确保了后续AI生成过程中,“工程化写作”方案得以落地——用多文件上下文确保设定一致性,通过规范(Me2AI)与台账(AI2AI)双系统实现长期稳定输出-。

5.2 第二步:结构化提示词设计

【方案一】基于三幕式冲突嵌套结构

【首层指令】 生成小说大纲,严格遵循"建置—对抗—结局"三幕式结构,第一幕占比30%,第二幕60%,第三幕10%。 【第二层追加】 在第二幕中,同步生成三条并行线索: - A线(明面职场危机) - B线(暗面记忆碎片回收) - C线(第三方势力对能力来源的溯源) 每条线索标注关键转折节点及交汇时刻。 【校验要求】 检查交汇时刻是否全部落在同一章节编号内,且触发复合型后果。

-14

【方案二】基于角色驱动型提示词模板

请为一部都市异能类长篇网文生成详细大纲,主角是28岁前特勤档案员,因接触禁忌数据觉醒"时间残响"能力——可回溯他人3秒内的行为痕迹,但每次使用会随机丢失自身一段记忆。要求:分五卷,每卷包含核心事件、反派阶段性目标、主角能力代价升级点。 【追加约束】 禁止添加穿越、系统、重生设定;所有超自然现象必须绑定主角记忆缺失机制。

-14

5.3 第三步:多轮续写的一致性控制

针对长篇连载的场景,采用“计划→生成→校验→润色”四道工序:

伪代码示例:小说章节生成流程 def generate_chapter(prev_context, chapter_outline): Step 1: 加载已有上下文 context = load_world_setting() + load_character_profiles() + load_previous_chapters() Step 2: 构建增强提示词 prompt = f""" 基于以下已有设定和情节,生成第X章正文: 【世界观约束】:{world_setting} 【人物状态】:{character_states} 【前文摘要】:{prev_summary} 【本章大纲】:{chapter_outline} 要求: 1. 严格保持人物性格一致性 2. 确保本章情节与前文逻辑连贯 3. 文风统一,避免突兀风格转换 4. 本章结尾设置悬念钩子 """ Step 3: 生成初稿 draft = llm.generate(prompt) Step 4: 校验一致性 issues = consistency_check(draft, context) if issues: draft = refine_with_feedback(draft, issues) return draft

5.4 第四步:文笔润色与风格优化

针对“文笔干瘪、情绪渲染不到位”的问题,使用Claude进行精细化润色:

【润色指令】 请保持原意不变,但增加环境描写来烘托悲伤氛围,强化主角的心理活动,让对话更富有张力。输出前请检查:人物语气是否统一?情绪递进是否自然?是否有冗余重复的修饰词?

-11

5.5 新旧方式效果对比

| 环节 | 传统创作方式 | AI辅助创作方式 |

|---|---|---|

| 脑洞构思 | 数天至数周 | 数分钟内生成多个版本 |

| 大纲搭建 | 3-7天 | 30分钟迭代完成 |

| 正文写作(日更4000字) | 3-5小时,易卡文 | 1-2小时,AI协助突破卡点 |

| 逻辑一致性检查 | 人工通读,易遗漏 | 自动校验,标注可疑节点 |

| 风格稳定性 | 依赖状态,波动明显 | 可设定风格模板,持续统一 |

有实测数据显示,当前AI已能解决90%的基础写作问题,但核心创意仍需作者把控-12。这正是“人机协作”而非“机器替代”的核心要义。

六、底层原理/技术支撑

6.1 Transformer架构与注意力机制

大语言模型的核心技术底座是Transformer架构,其革命性创新在于自注意力机制(Self-Attention) 。简单理解:当模型处理一句话时,它能“同时关注”句子中所有词之间的关系,而非像传统RNN那样逐个词顺序处理。这使其能捕捉长距离的语义依赖——对于小说创作而言,意味着模型能够跨越数十页的内容,维持角色性格和叙事风格的一致性。

以Claude 4.6 Opus为例,凭借其优秀的上下文注意力机制,在中长篇幅(30万字以内)的连载中表现极其稳定-33。

6.2 RAG(检索增强生成)架构

RAG(Retrieval-Augmented Generation,检索增强生成) 是解决长篇小说“设定遗忘”问题的核心技术方案。它将故事宇宙编码为可检索的外部记忆体,解决超长篇创作的叙事熵增问题-44。

具体工作流程:

【用户输入】→【检索向量数据库】→【召回相关设定】→【拼接上下文】→【LLM生成】→【输出】 ↓ 人物卡/物品栏/时间线切片

在2026年的AI写作工具中,垂直类工具放弃了暴力的长窗口硬扛方式,转而将小说设定(人物卡、物品栏、时间线)切片存入向量数据库。每次生成新章节时,系统自动检索相关设定并注入上下文,从根本上避免了长篇连载中的设定遗忘-33。

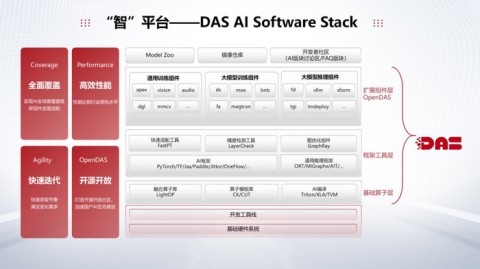

6.3 多Agent协同架构

多Agent协同架构(Multi-Agent Collaborative Architecture) 是将复杂创作任务拆解为多个专业化子任务的技术方案。以蛙蛙写作为例,其将创作流程拆解为情节构思、文风适配、细节填充三个模块,每个Agent专注特定环节并实现数据互通,避免创作者频繁切换工具的麻烦-3。

6.4 关键技术参数

| 技术指标 | 2026年代表水平 | 对小说创作的影响 |

|---|---|---|

| 上下文窗口 | 200K token(ChatGPT-4 Turbo)-3 | 可一次性处理完整长篇框架 |

| 指令理解准确率 | 98.2%(RLHF+DPO双优化)-3 | 提示词响应更精准 |

| 推理能力 | 深度推理(DeepSeek-R1类模型)-44 | 支持复杂因果逻辑推演 |

| API调用延迟 | 低至50ms(MoE架构)-3 | 实时交互体验流畅 |

七、高频面试题与参考答案

Q1:请简述大语言模型(LLM)在小说创作中的核心应用场景。

标准答案要点:

① 结构搭建:利用LLM的推理能力生成三幕式/多线叙事大纲,典型场景如“用DeepSeek将模糊脑洞拆解为起承转合严密的章节大纲”-12。

② 文笔润色:利用LLM的语言能力优化情绪渲染与风格一致性,典型场景如“用Claude润色对话段落,增加环境描写烘托氛围”。

③ 逻辑推演:利用LLM的因果推理能力检查伏笔回收与设定一致性,典型场景如“用DeepSeek推演战斗胜负合理性,发现设定中的逻辑Bug”-11。

④ 灵感激发:利用LLM的创意生成能力快速产出多个脑洞变体和开篇钩子,克服写作瓶颈-23。

Q2:在AI辅助长篇连载中,如何解决“设定遗忘”问题?

标准答案要点:

① 工程化结构管理:建立小说工程目录,将世界观、人物档案、章节大纲分文件存储,确保AI生成时能获取完整上下文-。

② RAG检索增强生成:将小说设定切片存入向量数据库,每次生成时自动检索相关设定并注入上下文,从根本上避免遗忘-33。

③ 状态校验机制:在生成流程中嵌入一致性检查节点,自动对比新生成内容与已有设定的冲突。

④ 分阶段续写策略:采用“计划→生成→校验→润色”四道工序,而非一次性生成长文本-。

Q3:DeepSeek、Claude、ChatGPT在小说创作中各自擅长什么?

标准答案要点:

| 模型 | 核心优势 | 适用场景 | 局限性 |

|---|---|---|---|

| DeepSeek | 逻辑推理强、结构化输出优秀 | 大纲搭建、设定管理、逻辑漏洞检查 | 文笔偏理科化,感情戏渲染弱-11 |

| Claude | 文学性强、长文记忆优异 | 文笔润色、情绪渲染、长篇连载 | API成本较高,缺乏项目级管理面板-33 |

| ChatGPT | 通用能力强、多模态支持 | 灵感激发、快速构思、多轮对话 | 中文网文风格需额外调优 |

Q4:什么是提示词工程?请举例说明其在小说创作中的应用。

标准答案要点:

提示词工程(Prompt Engineering)是通过精心设计输入指令,引导LLM输出符合预期内容的方法论。其核心在于:明确约束条件 + 结构化指令 + 提供参考样例。

应用示例对比:

❌ 劣质提示词:

写一个玄幻小说开头✅ 优质提示词:

生成玄幻小说第一章,背景设定在灵气复苏的现代都市,主角是高三学生,在月考当天觉醒了"时间回溯"能力(仅能回溯3秒)。开篇500字内需完成:展现主角的平凡处境、触发觉醒的关键事件、能力首次使用。语言风格参考《全职高手》的节奏感。

Q5:小说创作助手AI的底层技术架构包含哪些关键组件?

标准答案要点:

① LLM基座:提供核心语言理解与生成能力,如DeepSeek-V3、GPT-5.4等-3。

② RAG检索模块:通过向量数据库存储和检索小说设定,实现“外置记忆”-44。

③ 多Agent协同系统:将创作任务拆解为多个专业化子任务并行处理-3。

④ 上下文管理器:维护长文本的状态一致性,包括人物状态追踪、伏笔回收记录等。

⑤ 输出校验层:进行逻辑一致性检查、风格一致性评估和AI痕迹消除(去AI化处理)。

八、结尾总结

核心知识点回顾

LLM(大语言模型) 是小说创作助手AI的能力底座,提供了文本理解与生成的基础能力。

提示词工程 是调用LLM能力的方法论,决定了模型输出的质量上限。

RAG架构 解决了长篇连载的设定遗忘问题,通过向量数据库实现“外置记忆”。

多Agent协同 将复杂创作任务模块化,提升整体效率与输出一致性。

工具选型 应因需而异:逻辑推演选DeepSeek、文笔润色选Claude、通用场景选ChatGPT。

重点与易错点提醒

⚠️ 不要将AI视为“自动写作机器” —— AI的核心价值是“创意放大与落地”,而非替代创作者的思考-49。

⚠️ 提示词不能过于笼统 —— 模糊指令会让AI输出套路化、同质化的内容-49。

⚠️ 长篇创作必须有工程化结构 —— 缺乏状态管理的AI生成,等同于处理大量混乱的未暂存文件-33。

⚠️ 注意“去AI化”处理 —— 部分模型输出带有明显的“机器味”,需二次润色-33。

进阶学习方向

📘 微调与领域适配:如何用自有小说数据对大模型进行轻量级微调

📘 AI消痕算法:文本熵(Text Entropy)与人工痕迹检测与消除-42

📘 跨媒介管线集成:从小说文本到短剧脚本、视频内容的自动化转换

📘 多Agent创作框架:DeepWriter等学术框架的原理与应用-

下一篇文章,我们将深入探讨 “小说创作助手AI的微调实战:如何用自有作品数据训练专属风格模型” ,敬请期待。