2026年4月9日 北京时间

作为OPPO战略级AI助手,小布AI助手已在智能交互领域走过了六年演进之路。本文将系统拆解其核心技术架构——从感知智能与认知智能的双轮驱动,到Pipeline与E2E架构的深度融合,再到端侧大模型与Agent生态的协同落地,结合代码示例与面试要点,为开发者构建完整的技术知识链路。

一、小布AI助手概览:从语音助手到系统级智能体

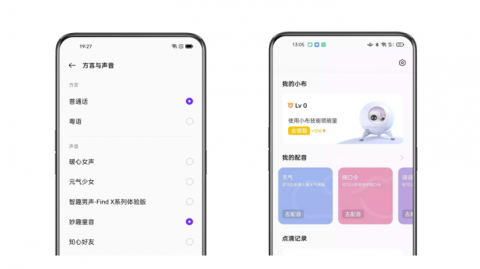

小布AI助手,英文名Breeno,是OPPO践行“科技为人,以善天下”品牌理念打造的战略级AI助手,内置在智能手机和IoT设备中-。它包含语音、建议、指令、识屏和扫一扫五大能力模块,以“机智”、“有趣”、“温暖”为理念提供多场景智慧服务。

截至2025年,小布AI的月活跃用户规模已达1.48亿,是国内头部手机AI助手之一-20。2025年10月,OPPO在AI峰会上首次提出AI操作系统(AIOS) 的三大技术基座——新计算、新感知与新生态,小布AI成为这一战略的核心载体-4。

学习痛点提示:很多开发者在使用AI助手时,只知道“调用接口”,却不懂背后的模型架构、对话管理机制和端云协同原理;面试时被问到“多轮对话如何实现”“知识图谱的作用”等问题时答不上来。本文从技术原理到代码实现,帮你打通从“会用”到“懂原理”的最后一公里。

二、痛点切入:传统语音助手的三大局限

在AI大模型普及之前,传统语音助手普遍面临以下痛点:

问题一:单轮交互,缺乏上下文记忆

传统助手只能一问一答,无法记住用户刚才说过的话。例如问“今天北京天气怎么样”,紧接着问“那明天呢”,助手往往无法理解“那”指的是什么。

问题二:意图理解能力弱,只能匹配关键词

传统助手依赖关键词匹配和规则引擎,用户换个说法就听不懂。比如“帮我定个闹钟”和“明天早上叫我起床”,在传统系统中需要分别配置不同的规则模板。

问题三:能力碎片化,功能之间缺乏协同

天气查询、闹钟设置、语音翻译等功能彼此独立,无法串联执行复杂任务。用户想“订一张去北京的机票,然后把行程添加到日历”,传统助手通常无法一次性完成。

正是这些痛点的存在,推动了小布AI助手向感知智能 + 认知智能双轮驱动的技术架构演进。

三、核心概念一:感知智能——让AI“听得到、看得到”

定义

感知智能是智能对话技术的基础层,侧重于让机器能够感知和理解人类的语音、图像、文本等信息-7。

关键技术拆解

小布AI助手在感知层面集成了以下核心技术:

1. 语音识别(ASR,Automatic Speech Recognition)

将用户的语音信号转换为文本。小布AI采用深度学习中的卷积神经网络(CNN)和自动编码器(AE)模型对语音信号进行特征提取和分类-2。CNN通过卷积层捕捉语音信号的局部时频特征,AE则通过编码-解码结构实现特征降维和噪声抑制。

根据第三方评测数据,小布AI的语音识别准确率可达98.5%-34。

2. 自然语言处理(NLP)基础层

在NLP领域,小布AI采用循环神经网络(RNN)和长短期记忆网络(LSTM)模型,这些模型能够有效处理序列数据(如文本和语音),捕捉语言中的上下文信息-3。RNN通过循环结构传递隐藏状态,理论上可以处理任意长度的序列,但存在梯度消失问题;LSTM通过输入门、遗忘门和输出门三个门控机制,解决了RNN的长期依赖问题。

类比理解:感知智能就像人的眼睛和耳朵——先把看到和听到的信息接收下来,转成大脑能理解的形式,但还不涉及“想”的部分。

四、核心概念二:认知智能——让AI“想得通、答得准”

定义

认知智能侧重于让机器像人类一样进行思考、推理、学习和决策,涉及知识表示、推理、学习、规划等多个领域-7。

关键技术拆解

1. 多轮对话管理(Multi-turn Dialogue Management)

小布AI采用序列到序列(Seq2Seq)模型和注意力机制(Attention Mechanism) 来实现自然流畅的对话-3。

Seq2Seq由编码器(Encoder)和解码器(Decoder)两部分组成。编码器将用户输入序列压缩为固定维度的语义向量,解码器根据该向量逐词生成回复。注意力机制的加入解决了固定维度向量的信息瓶颈问题——解码器在生成每个词时,可以“关注”输入序列中相关性最高的部分。

2. 知识图谱(Knowledge Graph)

知识图谱是一种以图的形式表示实体、属性和关系的知识库,节点代表实体(如“北京”),边代表关系(如“是首都”)。小布AI通过图神经网络(GNN)等模型,实现对海量知识的快速检索和推理-2。

3. 自研预训练大模型 OBERT

OPPO小布助手团队自研了十亿参数模型“OBERT” ,在中文语言理解测评基准CLUE1.1总榜位列第五,在大规模知识图谱问答KgCLUE1.0排行榜中位列第一-31。该模型清洗和收集了1.6TB级语料,通过5种mask机制从百科、社区问答、新闻等来源学习语言知识-31。

类比理解:认知智能就像人的大脑——理解语言的深层含义,结合已有的知识储备进行推理,然后组织出最合适的回答。

五、感知与认知的关系总结

| 维度 | 感知智能 | 认知智能 |

|---|---|---|

| 核心任务 | 信号采集与识别 | 理解与推理 |

| 典型技术 | ASR、CNN、AE | Seq2Seq、Attention、GNN、预训练模型 |

| 处理对象 | 原始语音/图像信号 | 语义、知识、逻辑关系 |

| 类比 | 耳朵、眼睛 | 大脑 |

一句话记忆:感知智能负责“输入”,认知智能负责“理解”;二者协同,才构成完整的智能对话体验。

六、代码示例:模拟多轮对话的意图识别与响应

以下代码模拟了小布AI助手多轮对话的核心处理流程——感知层将用户输入转为文本,认知层识别意图并调用相应服务:

小布AI助手 - 多轮对话意图识别模拟 class XiaoBuSession: def __init__(self): self.context = {} 上下文记忆 self.intent_handlers = { "weather": self.handle_weather, "alarm": self.handle_alarm, "calendar": self.handle_calendar } def parse_intent(self, text): """意图识别(简化版,实际使用OBERT模型)""" if "天气" in text: return "weather" elif "闹钟" in text or "叫醒" in text: return "alarm" elif "日程" in text or "日历" in text: return "calendar" return "unknown" def handle_weather(self, text): """处理天气查询,支持多轮上下文""" if "明天" in text: city = self.context.get("city", "北京") return f"{city}明天的天气是晴转多云,18-26℃" else: 提取城市信息并存储到上下文 cities = ["北京", "上海", "深圳"] for city in cities: if city in text: self.context["city"] = city return f"{city}今天天气晴朗,20-28℃" return "请问您要查询哪个城市的天气?" def handle_alarm(self, text): """处理闹钟设置""" import re time_match = re.search(r"(\d+):(\d+)", text) if time_match: hour, minute = time_match.groups() self.context["alarm"] = f"{hour}:{minute}" return f"已为您设置{hour}:{minute}的闹钟" return "请告诉我具体时间,比如'设置7:30的闹钟'" def respond(self, user_input): 感知层:接收输入(实际由ASR完成) 认知层:意图识别 + 响应生成 intent = self.parse_intent(user_input) handler = self.intent_handlers.get(intent) if handler: return handler(user_input) return f"小布暂时无法理解:{user_input},请换一种说法试试~" 运行示例 xiaobu = XiaoBuSession() print("【用户】:北京今天天气怎么样?") print(f"【小布】:{xiaobu.respond('北京今天天气怎么样?')}") print("\n【用户】:那明天呢?") print(f"【小布】:{xiaobu.respond('那明天呢?')}") print("\n【用户】:帮我定个7:30的闹钟") print(f"【小布】:{xiaobu.respond('帮我定个7:30的闹钟')}")

代码关键点说明:

self.context实现了多轮对话的上下文记忆(对应认知智能中的对话管理)parse_intent模拟了意图识别(实际由OBERT等预训练模型完成)实际生产环境中,ASR语音识别 + OBERT意图分类 + TTS语音合成构成了完整链路

七、底层原理:技术支撑体系

小布AI助手的上层能力建立在一系列底层技术之上:

1. 端侧大模型部署

小布AI的端侧模型实现了300 tokens/s的峰值推理速度,最长支持128k上下文窗口,强调本地计算的隐私保护与响应速度优势-4。

2. PersonaX记忆共生引擎

基于多模态传感器与泛在计算,打通设备状态、行为习惯、网络环境与情绪感知,构建用户级“终身记忆”,支撑AI长期进化-4。

3. 强化学习反馈优化

小布AI引入强化学习(Reinforcement Learning)技术,使对话系统能够根据用户的反馈(如点赞、点踩、是否重复提问等隐式信号)不断优化自身的行为-3。

4. 预训练 + 微调范式

采用“预训练+微调”架构,先用TB级通用语料进行自监督预训练(MLM任务),再用业务场景数据进行有监督微调,同时兼顾通用理解能力和领域适配性-31。

以上底层原理是进阶学习的重点方向,后续系列文章将逐一深入展开。

八、最新进展(2026年4月)

根据最新信息,小布AI助手在2026年有以下重要更新:

一句话点茶咖:自动锁定品牌、品类、规格与收货地址,支持外卖配送和门店自提-11

小布记忆支持账单导入:支持导入微信、支付宝账单表格到账单合集,识别聊天中的转账信息并自动记账-11

多图片上传问答:支持同时上传多张图片进行问答-11

AI简报:每日推送融合天气、待办、新闻的专属头条-12

个性化引擎:通过日常对话学习用户偏好和习惯,构建专属AI印象,实现千人千面的个性问答-12

九、高频面试题与参考答案

Q1:请简述智能对话系统中感知智能与认知智能的区别与联系。

参考答案:

感知智能负责从语音、图像、文本等原始信号中提取信息,涉及ASR、CV等技术;认知智能负责理解语义、进行推理和决策,涉及NLP、知识图谱、对话管理等。感知是认知的输入基础,认知是感知的深化应用。小布AI助手的“感知+认知”双轮驱动架构正是这一理念的体现。

Q2:多轮对话管理通常采用什么技术方案?

参考答案:

主流方案包括:1)基于Seq2Seq + Attention机制的生成式对话,适合开放域场景;2)基于状态追踪的规则式/任务式对话,适合任务型场景。小布AI采用Seq2Seq + 注意力机制实现自然流畅对话,同时引入强化学习根据用户反馈持续优化。评分要点:答出至少两种方案 + 说明各自适用场景。

Q3:知识图谱在AI助手中起什么作用?

参考答案:

知识图谱以图结构表示实体、属性和关系,为AI助手提供结构化的背景知识支持。在小布AI中,通过图神经网络(GNN)实现快速检索和推理,使助手在回答问题时能提供更全面、准确的信息。知识图谱与预训练语言模型互补——大模型提供泛化理解能力,知识图谱提供精确的事实知识。

Q4:小布AI端侧大模型相比纯云端方案有什么优势?

参考答案:

1)隐私保护:数据本地处理,无需上传服务器;2)低延迟:无需网络往返,响应更快;3)离线可用:弱网或无网环境仍可使用。小布AI端侧模型实现300 tokens/s推理速度,支持128k上下文,是端云协同架构的成功实践。

十、总结与展望

本文系统梳理了小布AI助手的核心技术体系:

✅ 感知智能:ASR + CNN/AE,将语音转为文本

✅ 认知智能:NLP + 知识图谱 + OBERT预训练模型,实现意图理解与推理

✅ 多轮对话管理:Seq2Seq + Attention + 强化学习,保障对话流畅自然

✅ 端云协同:端侧模型300 tokens/s推理 + 云端大模型协同

易错点提示:不要将“感知智能”和“认知智能”混为一谈,也不要把多轮对话管理简单等同于“记住上轮说了什么”——真正的多轮对话涉及上下文状态追踪、意图补全、指代消解等复杂机制。

未来,小布AI助手将朝着端边云协同、多模态融合、主动对话方向演进,成为用户生活中真正“懂你”的智能伙伴-7。

下一篇预告:深入拆解小布AI端侧大模型的部署技术——从模型量化到推理引擎,从128k上下文窗口到300 tokens/s的性能优化实践。