一句话读懂本文

如果你想理解智能语音助手背后的核心技术原理,或者正在准备AI Agent方向的技术面试,这篇文章将从架构选型、多轮对话原理到Agent核心能力,为你构建完整知识链路。

一、技术演进:从传统IVR到LLM驱动的语音Agent

在当前的语音AI产品中,以TT语音AI助手为代表的新一代智能语音系统,已经彻底告别了传统IVR(Interactive Voice Response,交互式语音应答)的菜单式交互模式,演进为具备多模态感知、上下文推理和业务闭环能力的Voice Agent-37。无论你正在开发智能客服、语音助手还是游戏陪玩机器人,理解这套技术架构都是必备基础。

传统实现的痛点,你可能正在经历:

传统的语音对话系统通常采用“规则引擎+关键词匹配”的模式:

传统规则引擎的典型实现 class TraditionalVoiceBot: def __init__(self): 预定义的规则库 self.intent_rules = { "天气": ["天气", "气温", "下雨"], "时间": ["几点", "时间", "现在"] } self.responses = { "天气": "今天天气晴,25度", "时间": "现在是下午3点" } def process(self, user_input): 关键词匹配 for intent, keywords in self.intent_rules.items(): if any(kw in user_input for kw in keywords): return self.responses[intent] return "我没听懂你说什么" 痛点:无法处理复杂意图、无上下文记忆、多轮对话体验差

这种方案的致命缺陷:

意图识别率低:传统规则引擎的意图识别准确率仅60%-70%,而基于Transformer架构的深度学习模型可达90%以上-42

无上下文记忆:用户说“帮我订机票”后再问“要多少钱?”,系统无法关联“机票”这一话题

缺乏多轮对话能力:无法维持超过3轮以上的连贯对话,扩展性极差

没有自主决策能力:只能执行预设规则,无法应对用户自然表达中的复杂语义

LLM驱动的变革:上述问题的根源在于传统系统缺乏“智能”。2026年的语音AI系统,以TT语音AI助手为代表,已经全面转向基于大语言模型(LLM,Large Language Model)的Agent架构,实现了从“被动响应”到“主动服务”的跨越-37。

二、核心概念:Voice Agent与LLM Agent

什么是LLM Agent?

英文全称:Large Language Model Agent

中文释义:大语言模型智能体,是具备自主决策与任务执行能力的AI系统,通过大语言模型理解环境、规划行动并反馈结果-47。

简单来说,大模型会“思考”,而智能体能“做事” -。以TT语音AI助手为例:当用户说“帮我找个队友今晚一起开黑”,传统系统可能只返回一个匹配链接,而Voice Agent会理解用户意图、查询在线好友状态、发起组队邀请、甚至根据用户历史战绩推荐合适的队友——它完成的是一个完整的任务闭环。

什么是Voice Agent?

英文全称:Voice Agent(语音智能体)

中文释义:以语音为主要交互方式的AI智能体,通过ASR(Automatic Speech Recognition,自动语音识别)、LLM、TTS(Text-to-Speech,文本转语音)三大核心模块,实现端到端的语音对话能力-3。

Voice Agent的技术栈包含四个核心组件:

STT/ASR(语音识别) :作为系统的“耳朵”,将用户语音实时转换为高准确率的文字-8

LLM(大语言模型) :作为系统的“大脑”,负责自然语言理解、推理与生成-8

TTS(文本转语音) :作为系统的“声音”,将响应文本合成为自然流畅的语音-8

编排层(Orchestration) :作为系统的“指挥家”,管理各组件之间的实时交互流程-8

LLM Agent vs 传统AI系统的核心区别

| 对比维度 | 传统AI系统 | LLM Agent |

|---|---|---|

| 决策方式 | 依赖预设规则 | 动态生成解决方案 |

| 任务能力 | 单轮问答 | 多轮自主规划执行 |

| 上下文感知 | 无状态或会话级 | 长期记忆+动态上下文 |

| 工具集成 | 预设API绑定 | 动态工具学习与调用 |

一句话总结:传统AI是“问什么答什么”,LLM Agent是“给目标、自己干”。

三、关键技术:语音Agent的两大架构流派

3.1 级联架构(Cascaded Architecture)——模块化设计的经典范式

级联方案采用 “ASR → LLM → TTS” 的流水线处理模式,是目前最成熟、最主流的语音Agent实现方式-1:

用户语音 → [STT] → 文本 → [LLM] → 响应文本 → [TTS] → 合成语音 → 用户优点:

各模块可独立优化,技术成熟度高

每个环节的输入输出清晰可见,便于问题定位与调试

合规友好,在金融、医疗等监管严格的行业中可使用经过认证的特定模型-6

缺点:

端到端延迟较高,典型值为2-4秒-6

语音中的语气、情绪、停顿等副语言信息在转录为文本时会丢失-6

多个组件独立运行,增加了系统复杂度和故障点

3.2 端到端架构(End-to-End Architecture)——未来的趋势方向

端到端架构通过单一神经网络直接完成语音到语音的转换,以GPT-4o Realtime、Gemini 2.5 Flash为代表-1-6。

优点:

上下文保持能力更强,可完整保留语气、停顿等副语言信息

延迟更低,实验数据显示端到端方案在长对话场景下比级联方案减少约300ms处理延迟-1

可自然扩展为语音+视觉等多模态联合建模

挑战:

训练数据需求量是级联方案的5-8倍-1

模型可解释性较差,出现问题时难以定位根因

架构选型建议:对于追求稳定性、可调试性的企业级场景(如客服系统),级联架构仍是2026年的主流选择;对于追求极致交互体验、低延迟的场景,可逐步向端到端架构演进。

四、多轮对话与全双工交互的实现原理

全双工交互:让人机对话真正“自然”

全双工语音交互要求系统能够同时处理输入和输出流,模拟真人对话中的“打断”与“插话”能力-1。这项技术的核心实现需要突破三大难点:

流式处理架构:采用增量式ASR与TTS技术,通过滑动窗口机制实现语音流的分段处理-1

上下文管理:构建动态上下文缓存,维护对话历史状态-1

打断处理机制:通过VAD(Voice Activity Detection,语音活动检测)与能量阈值动态调整,优秀商业系统可实现95%的打断响应准确率-1

多轮对话:LLM函数调用的实际应用

在多轮对话场景中,LLM需要维持长达数十轮的上下文一致性。例如,用户先问“今天有什么游戏比赛?”,再追问“几点开始?”,系统必须自动关联前文的“比赛”场景-。

实现多轮对话的核心技术是LLM函数调用(Function Calling) 或结构化输出,它允许LLM将自然语言指令转化为可执行的后端操作-3。以TT语音AI助手为例:

LLM函数调用的典型流程示例 class VoiceAgentFunctionCall: def __init__(self): 定义可用的工具/函数 self.tools = { "search_team": self.search_team, 队伍 "send_invite": self.send_invite, 发送邀请 "check_friend_status": self.check_status 检查好友在线状态 } def process_intent(self, user_input: str, conversation_history: list): 1. LLM分析用户意图并决定调用哪个函数 2. 从用户输入中提取参数(如游戏类型、时间段) 3. 执行函数调用并返回结果 pass def search_team(self, game_type: str, time_range: str): 调用后端服务符合条件的队伍 pass def send_invite(self, target_user_id: str, team_id: str): 发送组队邀请 pass

五、AI Agent底层原理:从感知到执行

一个完整的AI Agent并非单一模型,而是由多个功能模块协同构成的智能系统-85。其典型架构包含以下核心组件:

1. 感知层(Perception Layer)

负责从多源数据中提取语义信息,包括语音信号处理、文本意图识别等-85。

2. 记忆与知识库(Memory & Knowledge Base)

短期记忆:维持当前会话的对话历史

长期记忆:存储用户偏好、历史决策记录等-85

RAG(检索增强生成) :通过向量检索从外部知识库中获取相关信息,有效缓解大模型的“幻觉”问题-25

3. 推理与规划引擎(Reasoning & Planning Engine)

这是Agent的“大脑”,负责将目标分解为子任务、评估执行路径并动态调整策略-85。当前主流的推理模式包括:

ReAct(Reasoning + Acting)框架:通过交替执行“思考”与“行动”实现复杂任务,有效减少幻觉-47

反思与自纠(Reflection) :Agent在输出前会先检查自己的结果,形成“任务生成→结果检查→修正优化”的闭环-25

4. 执行与交互层(Action & Interaction Layer)

负责将决策转化为可操作指令,包括调用API、发送邀请、更新状态等-85。

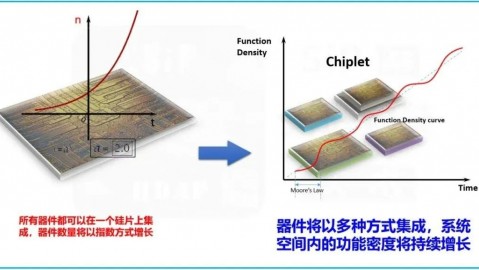

底层依赖技术:以上所有能力都建立在Transformer架构的自注意力机制(Self-Attention)之上,这是LLM实现上下文感知能力的理论基础。向量数据库(如Milvus、Chroma)、强化学习(RLHF)等技术共同支撑了Agent的工程化实现。

六、核心知识点汇总

本文覆盖的关键技术知识点如下:

| 模块 | 核心要点 |

|---|---|

| 架构选型 | 级联架构(ASR→LLM→TTS)vs 端到端架构;延迟、可解释性、训练数据的权衡 |

| 全双工交互 | VAD打断检测、动态上下文缓存、流式处理 |

| LLM Agent | 感知→记忆→推理→规划→执行;ReAct框架;反思与自纠 |

| 多轮对话 | 函数调用(Function Calling)、对话状态跟踪(DST) |

| RAG | 向量检索、多路召回、缓解幻觉 |

| 底层支撑 | Transformer自注意力机制、向量数据库、RLHF |

七、高频面试题与参考答案

以下是AI Agent方向面试中频繁出现的核心考题-73:

面试题1:什么是LLM Agent?它与传统AI系统的核心区别是什么?

参考答案要点:

定义:LLM Agent是具备自主决策与任务执行能力的智能体,通过大语言模型理解环境、规划行动并反馈结果-47。

三大区别:

自主性:Agent能动态生成解决方案,而非依赖预设规则

上下文感知:通过多轮交互和长期记忆维持任务连贯性

工具集成:可调用外部API、数据库或后端服务完成复杂操作-47

举例:当用户要求“帮我订明天的机票”,传统系统返回链接,而Agent会查询航班、比较价格并完成预订。

面试题2:如何实现多轮对话中的上下文管理?

参考答案要点:

对话状态跟踪(DST) :维护当前会话中用户的意图、槽位等信息

动态上下文缓存:存储最近N轮对话历史,在每次LLM调用时注入相关上下文

长期记忆:使用向量数据库存储用户偏好和历史决策,在需要时动态检索

LLM函数调用:通过结构化输出连接后端业务系统-3

面试题3:请解释ReAct框架的工作原理及其优势

参考答案要点:

定义:ReAct(Reasoning+Acting)通过交替执行“思考”与“行动”实现复杂任务-47

工作流程:

观察阶段:接收用户输入与环境反馈

推理阶段:LLM生成思考链(Chain-of-Thought)

行动阶段:选择动作并执行

迭代优化:根据结果调整策略-47

优势:显著减少大模型的幻觉(Hallucination)现象,提升任务成功率

面试题4:Voice Agent的端到端延迟主要来自哪里?如何优化?

参考答案要点:

延迟来源:STT识别(100-500ms)+ LLM推理(200-2000ms)+ TTS合成(200-800ms)-6

优化策略:

模型轻量化:使用知识蒸馏技术减少模型参数量

异步处理:将非实时操作放入队列并行处理

流式输出:实现增量式ASR和流式TTS,边识别边输出

缓存机制:缓存常见问题的答案

典型目标:人类对话的舒适延迟是300-500ms,2026年的先进方案可将级联延迟压缩至2秒以内,端到端方案可做到亚秒级-6

八、结尾总结

本文围绕TT语音AI助手这类智能语音系统的技术架构,梳理了以下核心知识点:

架构演进:从传统规则引擎到LLM驱动的Agent,实现了从“问答”到“执行任务”的范式转移

核心架构:级联架构(ASR→LLM→TTS)仍是当前企业级应用的主流选择,端到端架构代表未来趋势

关键技术:全双工交互依赖于VAD打断检测与动态上下文管理;多轮对话依靠LLM函数调用与对话状态跟踪

Agent底层:感知→记忆→推理→规划→执行的五层架构,底层依赖Transformer自注意力机制与向量数据库

面试要点:掌握LLM Agent与传统系统的区别、ReAct框架、上下文管理策略是面试通关的关键

下一讲预告:下一篇文章将深入RAG(检索增强生成)技术的实现细节,带你从零构建一个企业级知识库问答系统,欢迎持续关注。

本文数据来源:行业研究报告及2026年最新技术文献。内容仅供参考,具体技术选型请结合业务场景评估。

📌 版权声明:本文由TT语音AI助手参与资料整理,内容仅供学习交流,转载需注明出处。