大家好啊,我是老张。今天不聊别的,就说说我这一个星期是怎么被一个叫“ai文件 代理”的东西折腾得欲仙欲死的。

事情是这样的,上周末我不是寻思着搞点AI玩玩嘛,就在本地下了个开源的模型,想着自己跑一跑,省得老往云端跑,毕竟兜里那几个钢镚儿还得留着买烟抽。结果呢?模型是下载下来了,一个文件好几个G,躺在硬盘里跟个大爷似的,我怎么调它都不动弹。

后来我问了个群里的大佬,大佬轻飘飘地甩过来一句:“你得弄个ai文件 代理啊,不然咋整?”

我当时就懵了,啥叫ai文件 代理?这玩意儿长啥样?是硬件还是软件?得花多少钱?大佬估计被我烦得不行,发了条语音:“自己搜去!”语音里还夹着键盘噼里啪啦的声音,听得出来是在加班,我也没敢再问。

这玩意儿到底是干啥的?说白了就是个“中间人”

得,自己动手丰衣足食。我开始了漫漫百度路。翻了无数个帖子,看了好几篇教程,总算搞明白了一丢丢。

这个所谓的“ai文件 代理”,其实没那么玄乎。它就像是帮你跑腿的一个中间人。你想啊,你本地装的那个AI模型,它就是个光杆司令,它能思考但不会“出门”。如果你想让它去调用个啥功能,或者你想从别的地方给它喂数据,它就抓瞎了。这时候,ai文件 代理就出场了,它负责把你的请求“包装”一下,递到该去的地方,再把结果给你拿回来-8。

我打个比方吧,这就像你去官府办事,你知道要找哪个大人(模型就在那儿),但你不知道门朝哪开,也不知道进门该咋说(网络协议、接口认证)。这时候你找了个师爷(代理),师爷门儿清,他帮你递帖子、送银子,事办完了把结果往你手里一塞,你就啥都不用管了-5。

这么一想,是不是就通了?

但我这人吧,有个毛病,就是脑子会了手不会。理论懂了,一上手实操,立马歇菜。我按照一个教程说的,想搞个内网穿透,把我家里的电脑变成服务器,这样我出门在外也能用手机调家里的AI。教程里说的那个叫“llamafile”的东西,据说直接把模型和运行环境打包成一个文件,听起来挺简单的-1-7。

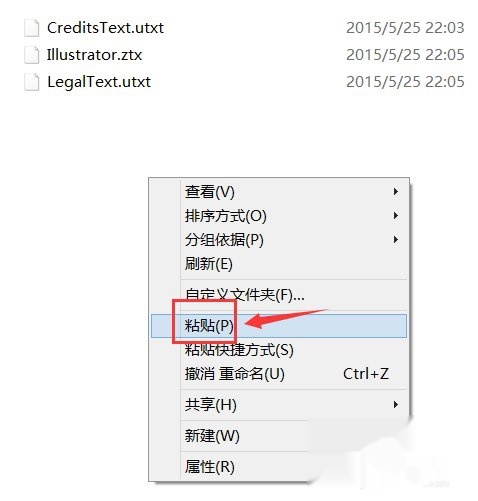

结果呢?我按照步骤,把那个llamafile后缀改成.exe,在命令行里一敲,嘿,还真跑起来了!浏览器打开localhost:8080,那小对话框嗖的一下就出来了,当时那个激动啊,感觉自己瞬间从菜鸟晋级成了极客。

然后问题就来了,怎么在外面访问呢?教程说要用花生壳内网穿透。我又去下花生壳,配置映射。这ai文件 代理在这时候就又变了个脸,它得负责把外网的请求安全地“引渡”到我家的电脑上-1。我折腾了半宿,终于在第二天上班摸鱼的时候,用手机流量连上了家里的AI。当时我举着手机差点在工位上喊出来:“成了!”旁边同事像看傻子一样看我。

那些坑啊,真是踩出来的经验

不过,这种快乐没持续两天,新麻烦就来了。

我用那个代理跑一个稍微复杂点的任务,让它帮我整理一堆乱七八糟的文档。结果这家伙反应慢得像蜗牛,而且答着答着就“断片”了,要么报网络错误,要么直接给我来一句“该文件不存在”。

我那个火啊,蹭蹭往上冒。后来去论坛里发帖问,有个老哥回复我说:“你是不是没用对ai文件 代理的类型? 你那是穿透用的,处理大文件你得考虑API中转或者模型聚合平台,那种带故障转移的,这个跪了下个顶上,不会卡死-6-9。”

我这才意识到,原来“代理”这东西还分三六九等。有的代理就像乡间小路,你骑个自行车没问题;有的代理是高速公路,专门给大卡车跑的。我要处理大文件,得找那种支持多模型、能自动切换、还带缓存功能的-9。论坛里还有人推荐那种模型聚合平台,说改一行代码就能调用Claude、Gemini这些,不用一个个去折腾-6。

说实话,看到这些信息我更头疼了。信息太多了,什么API2D、CloseAI、云雾API,看得我眼花缭乱。有个叫“PackyCode”的被好几个老哥提起,说文档做得好,老板人也不错,就是Gemini偶尔会抽风-9。还有个叫“ZetaTechs”的,说是质量高但贵,适合当“备胎”用-9。

我心想,这不就跟找对象一样嘛?既要长得好看(稳定),又要会过日子(便宜),哪有那么好的事儿?

后来我也想开了,咱也不是啥大公司,就是自己玩玩,没必要追求百分百完美。我就挑了个性价比看着顺眼的,充了十块钱,先试试水。

你还别说,换了个路子之后,真顺溜了不少。至少那个“网络错误”的弹窗少多了。我用它把我那几百份散落在各个文件夹里的工作周报、项目总结全给扒拉了出来,让它按时间线给我整理成一个完整的文档。这家伙吭哧吭哧跑了大概十分钟,居然真给我整出来了!虽然有些地方格式有点乱,但比我预期中已经强太多了,那一刻心里头还真有点小成就感。

总结一下我这血泪史

所以啊,兄弟们,如果你也在玩本地AI,或者准备入坑,对于这个“ai文件 代理”的事儿,我掏心窝子说几句:

先搞清楚你要干啥:你是想远程访问自家的电脑(用内网穿透),还是想稳定调用云端的大模型(用API中转),目的不同,用的代理工具天差地别-1-6。

别怕花钱试错:很多中转站都有几块钱的试用或者最低充值,花个块儿八毛的,买个安心。别像我似的,在一个不合适的工具上死磕一礼拜,那时间成本比那点代理费贵多了-9。

看文档比问人强:很多问题其实人家官方文档里写的明明白白,就是字多,大家不爱看。但说实话,耐心看一遍文档,比在群里当“伸手党”有效率得多。

行了,今天就啰嗦到这儿。我知道在座的各位都是大神,肯定比我懂的多。我这也就是分享点个人经历,给刚入门的朋友提个醒。

结尾网友互动环节:

网友“码农小白”问:

“老张,看你写得挺热闹,我还是有点迷糊。我就是个普通用户,想用AI帮我写写邮件、改改文案,不搞那些复杂的编程。我到底需不需要搞这个什么ai文件 代理?如果需要,最简单的方法是什么?”

答:

兄弟,你这个问题问得特别好,也是大多数普通用户最关心的。这么说吧,如果你只是想在网页上或者用现成的软件(比如一些集成了AI的编辑器)来使用AI,那你大概率不需要自己折腾代理。因为那些软件的服务商已经帮你把背后复杂的网络连接都处理好了,你直接充值用就行,省心省力。

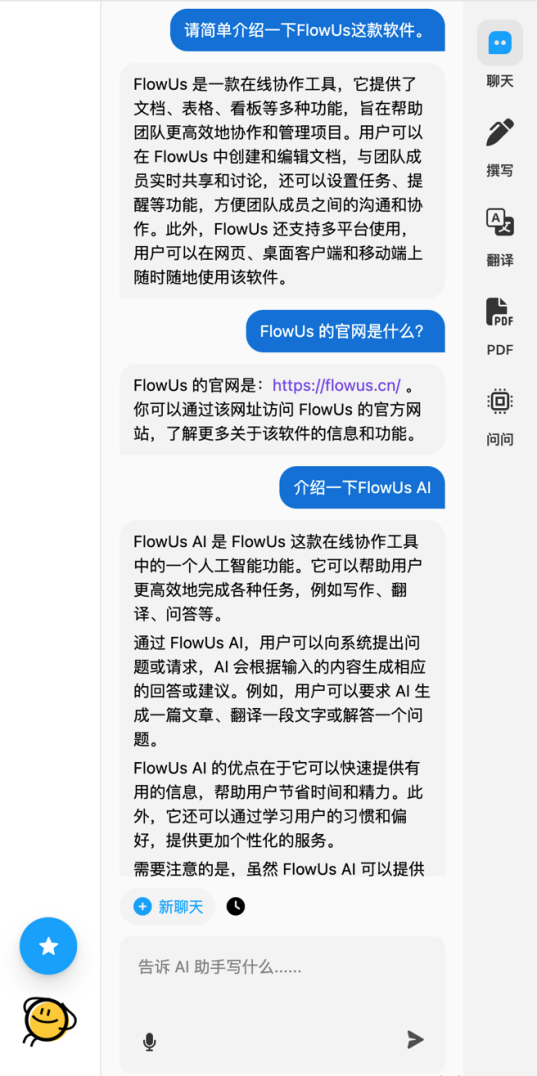

但是,如果你想追求极致的性价比,或者想用一些非常新的、国内还没有正式接口的模型(比如某些最新的开源模型或者需要特定渠道访问的模型),那你就得考虑“中转”这种形式了。简单来说,就是你去买一个第三方的API key,然后在你使用的软件(比如一些支持自定义API的聊天客户端)里改一下设置,把默认的地址换成他们给你的地址。这就相当于你找了个懂行的邻居,他家里拉了根专线,你每个月给他交点钱,从他家“借个网”用用,比自己拉专线(自己搭代理)省钱,也比直接找运营商(官方直连)在某些情况下选择更多-6。

最简单的入门方法,就是去那些技术论坛或者口碑聚合网站(比如有人提到过的CheapAI之类的)看看大家最近的评价。找那种支持“按量付费”、起充门槛极低(比如一块钱、十块钱)的服务商。先花小钱买个体验套餐,在他们的网站上看懂接入文档,现在很多服务都做得跟官方几乎一样,只需要复制粘贴一个key和修改一个地址就行。这就跟你第一次用支付宝一样,绑张卡,扫个码,后面就顺手了。千万别一上来就买那种好几百的包年套餐,先试水,觉得水流稳了再“下水游泳”-9。

网友“技术控老李”问:

“我用你提到的那个llamafile加花生壳搞了内网穿透,确实能在外面连回家了。但我发现一个问题,就是速度特别慢,而且好像不太安全,谁拿到我的地址都能问我的AI两句。有没有什么办法能优化一下速度和安全性?”

答:

老李,一看你就是个动手能力强的!能搭起来这一步已经超越了80%的人。你提的这两个问题确实是内网穿透的痛点,咱得想办法给它治一治。

先说安全。llamafile默认确实是个“裸奔”状态,谁敲门都给开-1。花生壳这类工具其实自带了“门禁系统”。你进到花生壳的管理后台,找那个映射的域名,一般都有“访问鉴权”或者“安全策略”的设置。你可以给它加个访问密码(Web访问口令),这样别人点进去先得输密码,跟进小区门禁似的。更高级一点,你可以设置“IP白名单”,只允许你公司的IP或者你手机流量的IP段访问,其他的统统拦在外面。这就好比你不仅给家门加了锁,还规定只有你认识的几个人能进小区大门,安全系数一下就上去了-1-7。

再说速度。内网穿透速度慢,多半是因为数据得先跑到花生壳的服务器上“绕一圈”再回来,那个服务器要是离你远,或者用的人多,就卡了。有几个优化思路:第一,检查你本地上传带宽。你家宽带的“上行速度”决定了你往外发数据的快慢,很多时候慢是卡在自己家水管细。可以打电话问问运营商能不能提一下上行。第二,选择离你近的节点。有些穿透工具付费版可以手动选择节点,比如你在北京,就选华北地区的节点,别让它给你自动连到广东去,物理距离越近,延迟越低。第三,如果条件允许,可以试试看有没有支持P2P模式的穿透工具。这种模式就像你直接给对方打电话,不通过总机转接,速度会有质的飞跃,但有时候网络环境复杂不一定能打通。安全和速度,有时候需要花点小钱买个付费版才能体验更好,就当给咱的AI请了个专业保镖和司机吧-1。

网友“大厂打工人”问:

“关注你很久了。我在公司用AI处理一些内部数据,特别担心数据泄露。用那些第三方的API中转站,总感觉数据会被别人看到。有没有什么办法能保证数据绝对私密?是不是必须得完全本地化部署才行?”

答:

兄弟,你这个问题触及到了现在很多公司用AI的核心焦虑——数据隐私。你这种担心太正常了,把公司内部数据交给第三方,心里确实没底。这事儿咱得两说着。

你说的没错,追求“绝对私密”,物理隔离的本地化部署确实是终极解决方案。就像咱们之前聊的,弄一台好电脑,或者一个本地服务器,把模型完全装在自己硬盘里,所有数据处理都在自己眼皮底下进行,数据不出门,神仙也偷不走-1-3。像一些开源的、参数不是特别巨大的模型,现在优化得很好,普通工作站也能跑得有模有样。这就是自己家建了个金库,钥匙自己攥着。

但是,本地部署也有局限,比如对硬件要求高,而且模型能力可能比不上那些顶尖的云端闭源模型。那怎么办?如果你的工作流必须用到那些顶级模型,又想尽量保护隐私,那就要学会“信息脱敏”和“筛选可信服务商”。

“信息脱敏”就是给数据“穿上马甲”。在把数据发给第三方API之前,自己先处理一下。比如把客户名字改成“客户A”,把具体金额改成一个范围,把涉及商业机密的专业术语换成通用的说法。让AI帮你分析的是“骨架”,而不是“血肉”。这就好比你让律师帮你打官司,你告诉他案件事实,但不用告诉他你家保险柜密码。

在选择服务商时,擦亮眼。尽量选那些承诺不记录数据、支持数据立即销毁、有正规商业背景而非“灰色地带”的模型聚合平台-6。有些企业级的服务还提供私有化部署的API版本,也就是模型在云端,但为你开辟一个独立的、加密的“保险箱”空间,别人进不来。这在法律上有“数据合规”的保障,跟那种个人小作坊式的中转站有本质区别。所以,要么全本地,要么“穿好马甲”再出门,要么找靠谱的“大牌保镖”,这三条路,你得根据手里的活儿有多敏感来选。