说真的,你有没有过这样的经历?凌晨两点半,办公室只剩你一个人,泡的咖啡早就凉透了,眼睛盯着屏幕都开始重影,但后台还有几万条用户评论等着过。鼠标滚轮滑一下,十条里头有三条是那种让你心里咯噔一下的内容——不是搞颜色的,就是骂人祖宗十八代的,甚至还有那种让你后背发凉的涉恐言论。

我有朋友之前在那种中小型社交平台做审核主管,有回一块撸串喝酒,他喝大了直接跟我掏心窝子:“你是不知道,我现在看见‘草’这个字都想吐。生理性想吐。”他说他们团队招人特别难,很多小孩干不到三个月就跑路了,为啥?心理扛不住啊。天天看那些阴暗面,有的人下班回家连自家孩子都不想抱,怕把那种负能量带回去。

这就是最真实的行业现状。以前咱们总觉得内容审核嘛,不就是看看帖子、删删差评?结果呢?现在是内容多得跟山洪暴发似的,人工审核员拿命在填坑 -2。成本高得吓人不说,关键是效率还跟不上,这边你刚审完一条涉黄内容,那边AI生成的变种违规文本又变着花样冒出来了 -4。我跟朋友说,你们这就跟拿长矛戳坦克似的,装备代差太大了。

直到后来,他们公司终于开窍了,上了现在圈子里特别火的那个——AI内容审核代理。

你别一听“代理”俩字就觉得是推卸责任,这玩意儿其实就是给你的审核团队配了一个不知疲倦的超级外挂。它不是简单地替代人,而是像咱们打游戏时候的“自动战斗”脚本。我朋友他们接进去之后,头一个星期数据出来,整个人都懵了——以前需要七八个人熬大夜干的活儿,现在这个AI智能体一夜之间就搞定了七八成,而且那家伙是7x24小时连轴转,不需要喝水,不需要上厕所,更不会因为看多了血腥图片而做噩梦 -2。

效率翻倍都是保守的,有的业务场景下,效率直接飙到以前的10倍 -1。我那朋友现在终于能正常下班回家陪孩子了。用他的话说:“我现在的工作,终于从‘垃圾分拣员’变回‘人’了。”

这玩意儿真能懂人话?别把AI想得太死板

可能有人要杠了:AI审核?不就是设几个关键词屏蔽吗?那也太蠢了,打个谐音、发个表情包不就绕过去了?

你要是这么想,那就把现在的技术给看扁了。现在的AI内容审核代理早就不是当年那个死板的关键词过滤器了。它用的是那种大语言模型,特别擅长“读空气”。

我给你举个真实例子。前段时间有个做带货直播的朋友,他们的评论区差点出大事。有个竞对的水军在直播间刷“这款酒真不错,喝完感觉能上天”。传统的小模型一看,“上天”?正常词,过!结果呢?这个AI审核代理直接给拦截了,因为它结合上下文的直播语境——当时主播正在介绍酒的度数,下面突然有人刷“上天”,这分明是隐喻喝完要“升天”,是一种恶毒的诅咒 -1。

我当时听完整个人都麻了。你说这种活儿,要是光靠人工,得多少双眼睛才能盯得住?而且这种擦边球内容,一天可能冒出来几千条。全靠人盯人,审核员迟早得疯。现在有了这种能理解“潜台词”的AI,才算是真正把那些躲在阴沟里的老鼠给揪出来了 -4。

而且这玩意儿还有一点特牛,就是它学东西特别快。以前那些违规内容变种,审核员得开会讨论、更新规则表,折腾一两天才能堵上。现在这个AI,早上出现的新的违规话术,它下午自己就能通过对抗学习给识别出来 -4。这种迭代速度,才是对抗现在这些黑产团伙的底气。

出海做生意,别再闹“文化裸奔”的笑话了

还有一个事儿特别想唠唠,就是现在很多兄弟搞出海,做那种面向中东、东南亚的社交App或者游戏。内容审核这块,闹的笑话可真不少。

我认识一个做中东棋牌游戏的朋友,刚开始不懂,直接把国内的审核标准套过去,结果呢?把当地用户发的一个表达祝福的骆驼表情包给删了,还误封了一个大R(高付费)玩家的号。原因就是AI模型没受过训练,看不懂阿拉伯语里那种特定的文化梗,把正常内容当违规给误杀了 -6。

后来他们痛定思痛,换了一个专门针对出海场景的AI内容审核代理。这回好了,模型里预置了十几种主流语言的当地习俗和价值观,什么宗教禁忌、服饰要求,门儿清 -1。不仅不再误删那种祝福表情包,还能精准识别出那种用本地俚语包装的赌博导流信息。我那朋友说,这玩意儿就像是给平台请了个“本地通”,再也不用担心因为不懂文化而在海外“裸奔”了。

实际上现在越来越多的创业公司也想通了,与其自己招一堆昂贵的海内外审核员,不如直接把这事儿包给专业的AI代理。算一笔账,用AI的成本可能只有以前用人或者买那种落后系统的四分之一 -1。省下来的钱干点啥不好?优化产品、搞搞运营,不香吗?

说白了,AI审核这东西,它不是什么冷冰冰的机器,它就是那个替你和你团队挡在最前面、扛下所有脏弹的防爆盾。它把那种枯燥、致郁、高强度的体力活给干了,让咱们这些有脑子的人,去做点更有创造力的事儿。这不就是技术进步的意义吗?

好了,上面这些就是我作为一个旁观者,看着行业这几年摸爬滚打的一些碎碎念。我知道每家的情况都不一样,大家肯定心里还有挺多嘀咕的。刚好我这儿模拟了几个网友可能会问的问题,咱们就当在茶馆唠嗑,一块儿讨论讨论。

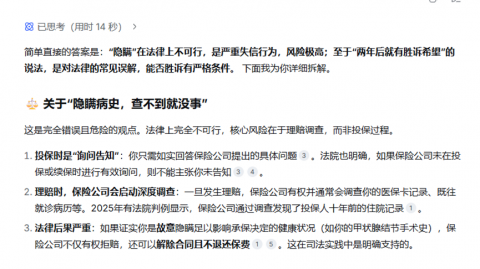

网友“运营小Z”问:

你说的这个AI审核代理这么神,那万一它抽风了,把我那些正常的用户都给误杀了怎么办?我那小平台,用户本来就少,再误封几个,不得被骂死啊?而且我们这小公司,哪有钱去试错啊?

我的回答:

哎呦,小Z你这问到点子上了,这也是以前我最担心的事儿。怕的就是那种“宁可错杀一千,绝不放过一个”的二愣子AI,那简直是用户流失的利器。

不过现在的玩法不一样了。我跟你说,现在的AI审核代理聪明着呢,它搞的是“人机协同”的打法,说白了就是让AI干粗活,人干细活 -6-9。

具体咋操作?它是这么个流程:第一道,让AI当门卫,那些明显是菠菜广告、赤裸裸的色情内容,它直接秒拒,这部分占了80%以上;第二道,那些稍微有点模糊的,比如带点调侃、或者像是擦边球的内容,AI会把它圈出来,打个标签“疑似”,然后推给人工审核员最后把关;第三道,那些特别复杂的,比如政治敏感或者隐晦的隐喻,AI才会上报给经验丰富的专家去判断 -2。

你看,这么一来,真正被AI直接“判死刑”的,都是板上钉钉的坏内容。那些模棱两可的,最后还是人说了算,这就大大降低了误杀率。而且现在很多AI平台都有那种“置信度”打分,你作为运营可以自己调阈值——想要严格点还是宽松点,你说了算 -1。所以你担心的那种“AI发疯”的情况,只要配置合理,基本不会发生。咱们小公司反而更适合用这个,因为不用自己养那么大一帮审核团队,成本一下子就降下来了,据我了解有的方案能帮你砍掉60%的成本 -4!

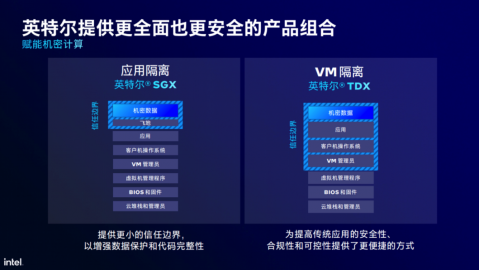

网友“技术控老王”问:

作为技术负责人,我更关心数据安全。这种审核服务,是不是要把我的用户数据全都传过去?万一数据泄露了,或者被竞争对手拿去训练模型了,这个锅谁来背?有没有那种能把数据攥在自己手里的方案?

我的回答:

老王你这个问题提得太专业了,一针见血。数据安全确实是现在很多企业的红线,特别是涉及到用户隐私和商业机密的。你放心,现在的供应商也不是傻子,早就想到这一层了。

现在的解决方案很灵活,不是只有“把数据交给别人”这一条路。目前主流的有两种玩法:

第一种是公有云API调用,适合那些对数据敏感度没那么高的业务。数据在传输过程中是加密的,而且大厂一般都有严格的隐私协议,承诺不会用你的数据去训练他们的通用模型,这点你可以写在合同里 -2。

但如果你真的特别在意,比如你是搞金融或者做政府项目的,那还有第二种方案——私有化部署 -10。这是什么概念?就是把整个AI审核模型,打包成一个“黑盒子”,直接部署在你自己的服务器上。数据完全不出你的内网,审核结果也都是在你自己的机房里算出来的。虽然这种方式前期投入会大一点,需要买硬件、调环境,但图的就是个心安。相当于你把这个AI审核员“买断”了,让它住你家,每天只为你一个人干活。市面上很多头部的风控平台都支持这种模式,你可以去找他们聊聊,看哪种更契合你们的需求。

网友“刚入行的审核员小刘”问:

大哥,我就是你文章开头说的那种审核员。刚入行三个月,现在每天做梦都是那些恶心的图片,感觉快抑郁了。如果以后都用AI了,我们这些人是不是就得失业了?我们这个职业还有前途吗?

我的回答:

小刘,看到你的留言,我心里特不是滋味,先给你一个隔空的拥抱。你说的这种状态,真的是审核行业很残酷的一面,那种心理创伤是外人很难理解的 -5-7。但我想跟你说,AI来了,对你来说可能不是“失业通知”,反而是“解脱通知书”。

你想啊,以前你像一头牛一样,被迫去耕那些最脏最累、最伤眼睛的“地”。以后呢?AI会把那80%的、真正让你生理不适的垃圾内容全都吃掉。而你,将从“垃圾分拣员”升级成“指挥官”或者“检察官” -4。

你的工作会变成什么?第一,你会去审核那些AI拿不准的疑难杂症,这考验的是你的真本事,而不是体力;第二,你会反过来给AI当老师,告诉它这次为什么判错了,那个案例该怎么优化,让AI变得越来越聪明 -2。这才是人该干的事儿嘛——去驾驭工具,而不是被工具异化。

所以说,前途大大的有。以后的企业需要的不是只会机械点鼠标的“审核机器”,而是懂业务、懂规则、能调教AI的“内容安全专家”。你的经验会变得更值钱。你要是实在扛不住,也可以考虑往这个方向转型,去乙方公司做AI的训练师或者策略运营,待遇和发展空间都比单纯做审核要好得多。千万别灰心,天快亮了。